RAG sobre documentos propios con AnythingLLM

· 2 min de lectura

Queremos hacer preguntas a un modelo sobre documentos privados sin enviarlos a servicios externos, y para ello usaremos AnythingLLM con Ollama como LLM runtime local.

-

Instalamos Ollama y descargamos el modelo que queramos usar para analizar los documentos.

-

Instalamos AnythingLLM y lo ejecutamos.

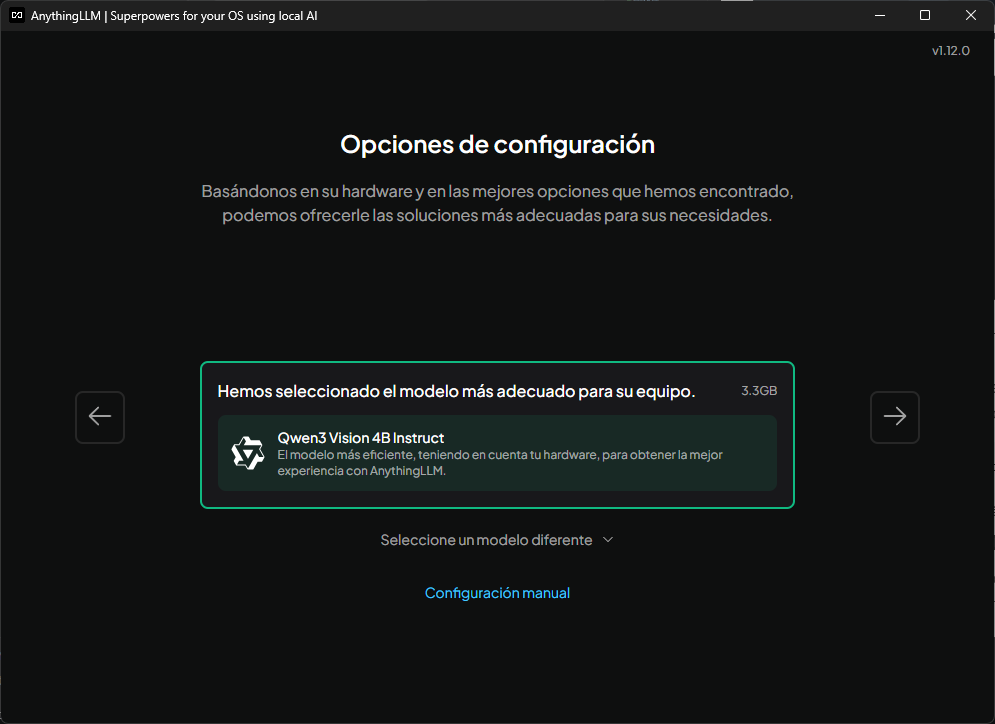

Si pulsamos "Comenzar", nos sugiere un modelo adecuado a nuestros recursos hardware, pero lo que queremos es usar Ollama como proveedor de modelos.

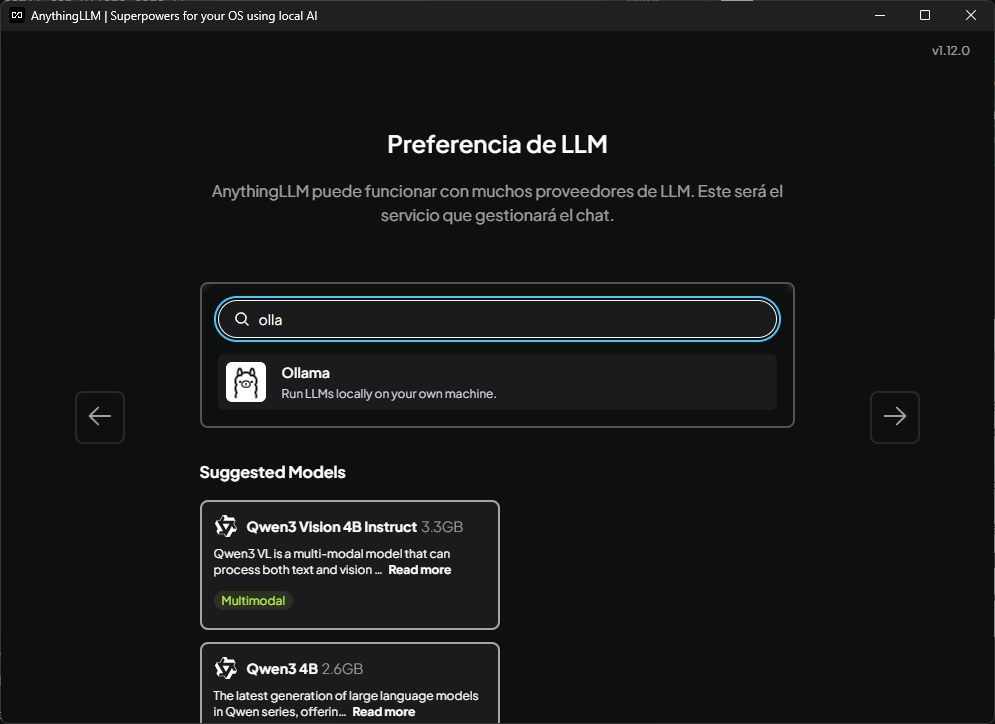

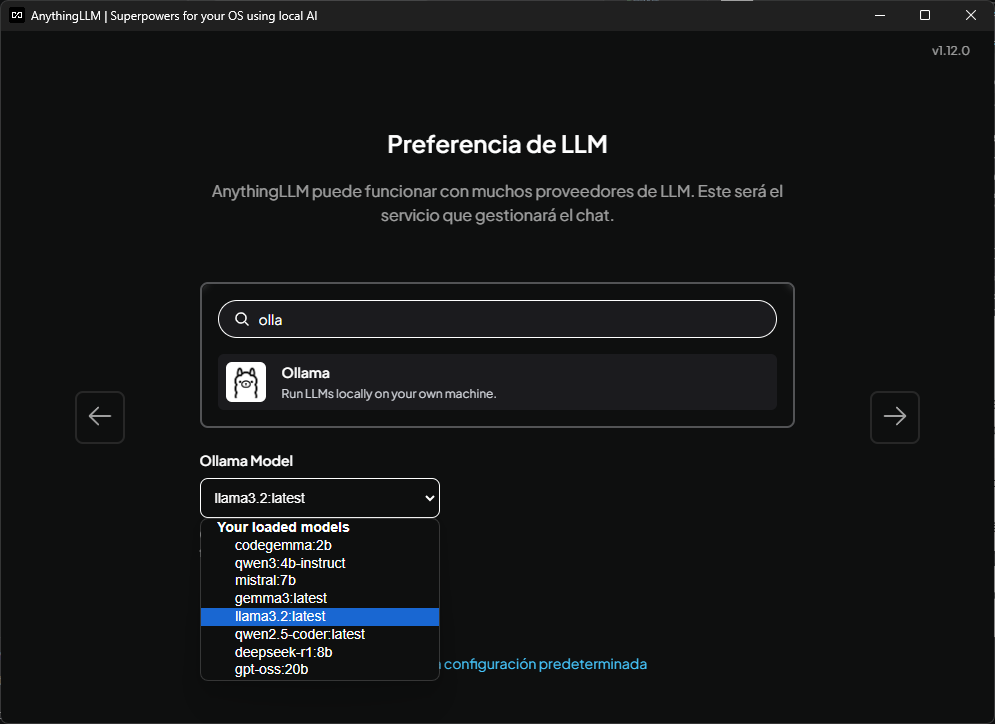

- Seleccionamos "Configuración manual" y localizamos "Ollama":

- Elegimos un modelo de entre los que tenemos disponibles en Ollama y terminamos el proceso de configuración inicial:

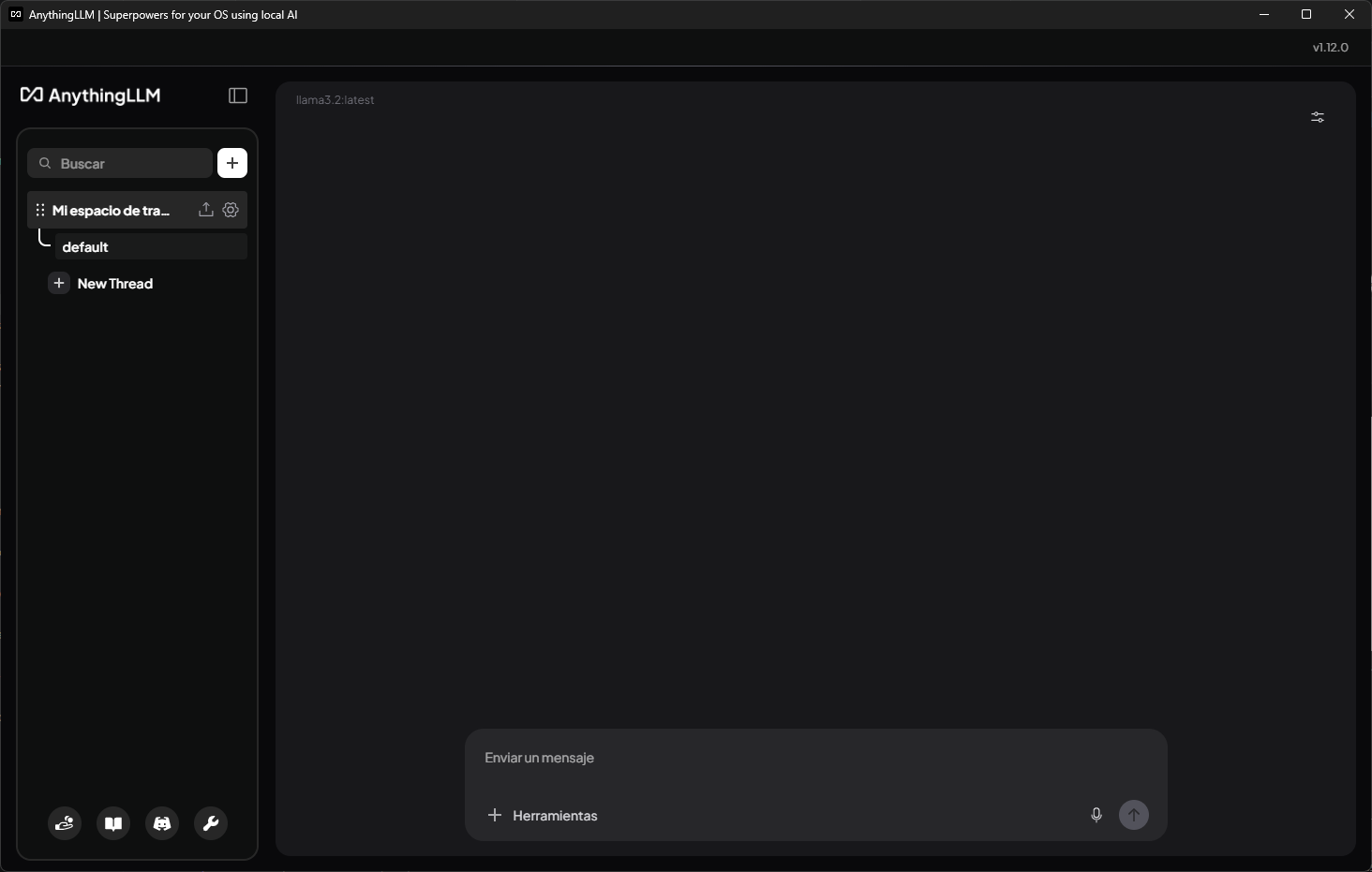

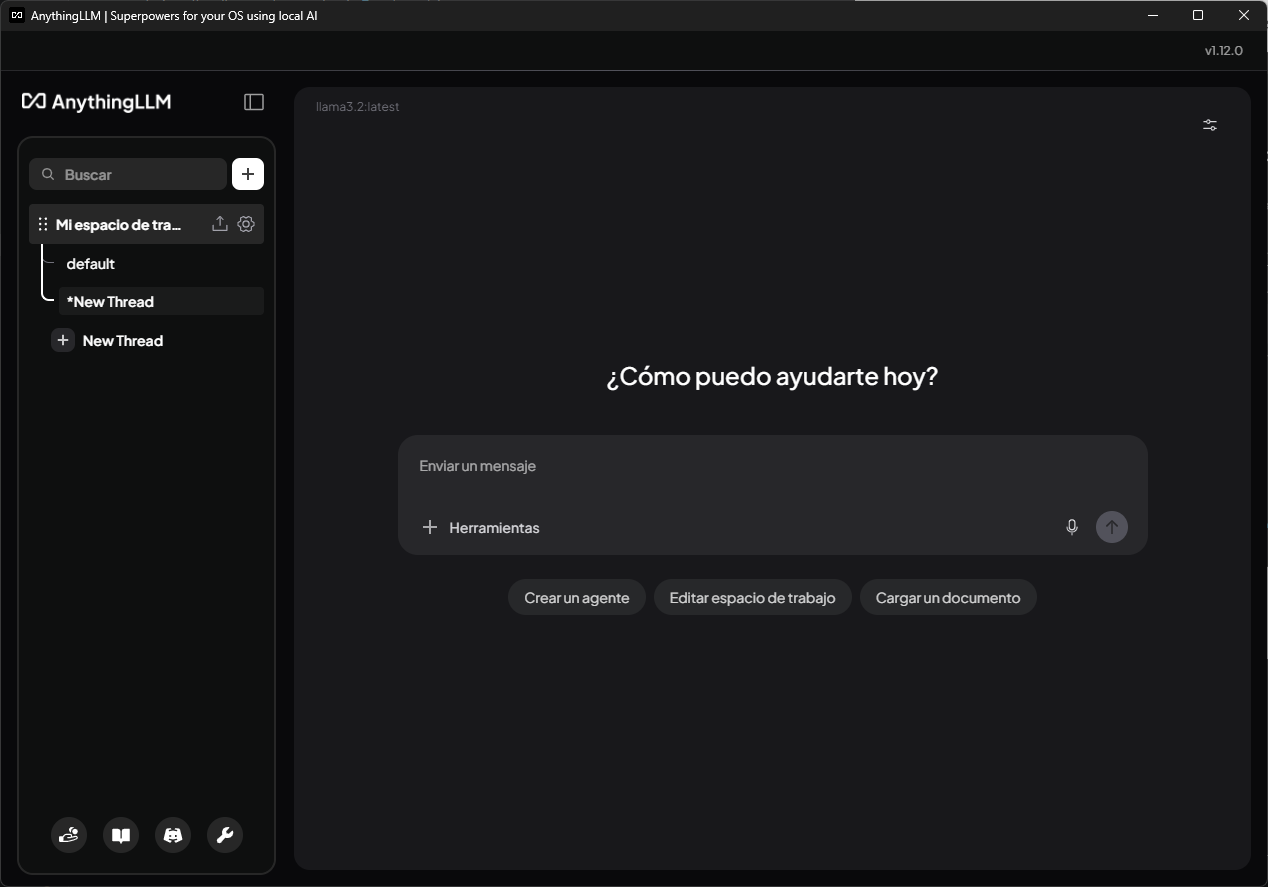

- Creamos un espacio de trabajo (workspace) al que adjuntar documentos y preguntarle a nuestro modelo local:

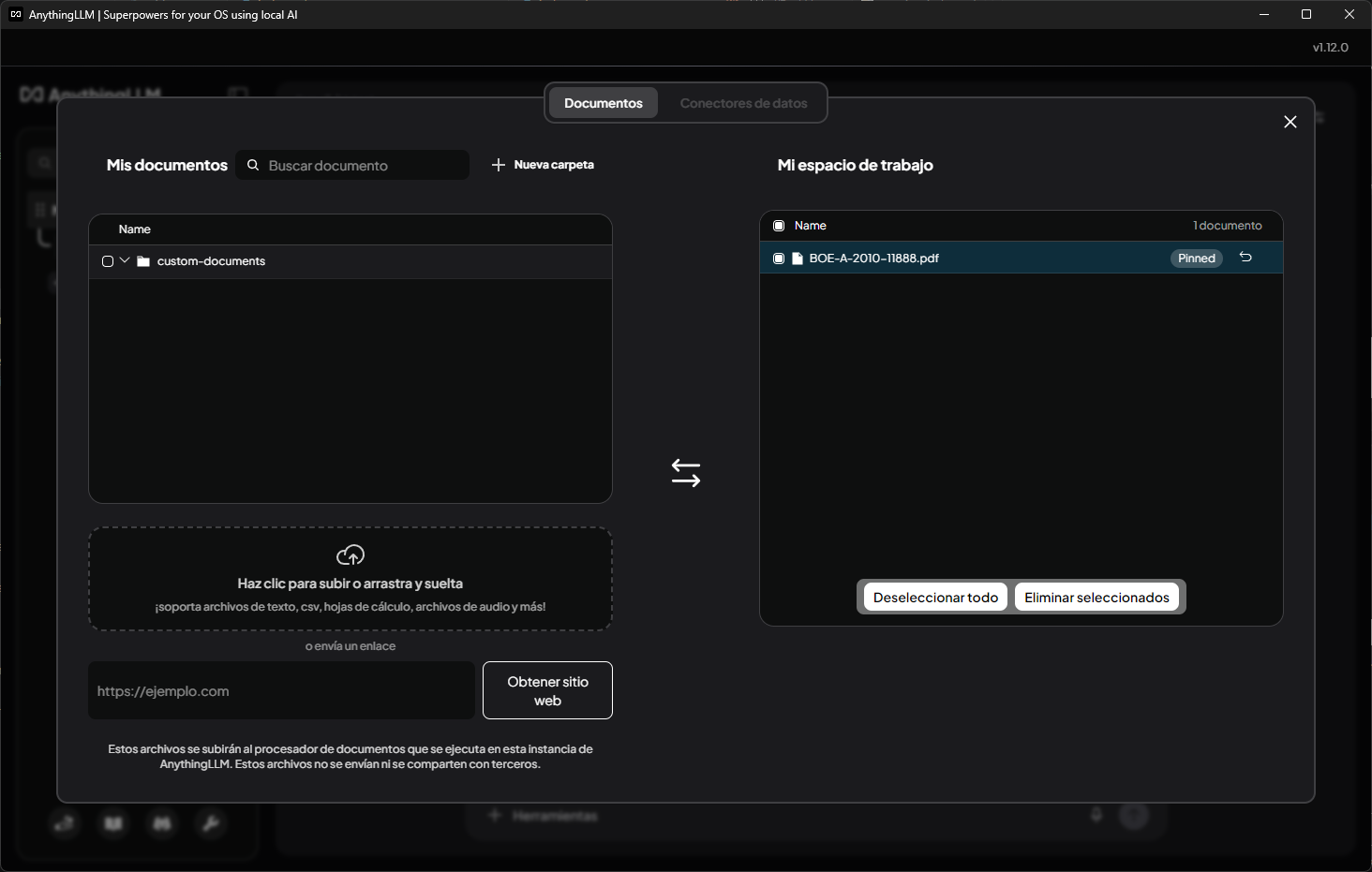

- Subimos un PDF al espacio de trabajo y lo pineamos:

- Y finalmente podemos hacerle preguntas sobre el contenido adjunto al espacio de trabajo: